तेजी से तकनीकी प्रगति के इस युग में, डीपफेक एक दोधारी तलवार के रूप में उभरा है, जो मनोरंजन और गंभीर खतरे दोनों प्रदान करता है। आइए विभिन्न प्रकार के डीपफेक के बारे में गहराई से जानें और इन डिजिटल रूप से हेरफेर की गई रचनाओं को पहचानने के तरीकों का पता लगाएं।

फेस-स्वैपिंग डीपफेक एक प्रमुख श्रेणी है जो पहले से मौजूद वीडियो में एक व्यक्ति के चेहरे की विशेषताओं को दूसरे पर सहजता से आरोपित करने के लिए परिष्कृत एआई एल्गोरिदम का उपयोग करती है। इन जोड़-तोड़ों के परिणामस्वरूप अक्सर ठोस लेकिन सूक्ष्म रूप से अप्राकृतिक परिवर्तन होते हैं। इस तरह के डीपफेक की पहचान में चेहरे के भावों की जांच शामिल होती है जो अजीब या तालमेल से बाहर हो सकते हैं, साथ ही प्रकाश व्यवस्था में विसंगतियों और अजीब आंखों की गतिविधियों पर भी ध्यान दिया जाता है जो डिजिटल हेरफेर का संकेत दे सकते हैं।

वॉयस क्लोनिंग डीपफेक किसी व्यक्ति की आवाज की नकल करने के लिए उन्नत एल्गोरिदम का उपयोग करते हुए ऑडियो क्षेत्र में गहराई से उतरता है। इस प्रकार को पहचानने में अप्राकृतिक विराम, रोबोटिक टोन या पिच में अचानक बदलाव जैसे सुरागों को ध्यान से सुनना शामिल है। ये अनियमितताएं संकेत दे सकती हैं कि ऑडियो सामग्री में हेरफेर किया गया है, जिससे डीपफेक की संभावित उपस्थिति के बारे में जागरूकता बढ़ रही है।

मैनिपुलेटेड ऑडियो-विज़ुअल डीपफेक का दायरा केवल चेहरे या स्वर में बदलाव से परे है, जो परिवर्तित ऑडियो सामग्री के साथ हेरफेर किए गए वीडियो को सिंक्रनाइज़ करके एक कथा बुनता है। पहचान में श्रव्य और दृश्य तत्वों के बीच सामंजस्य को क्रॉस-सत्यापित करना शामिल है, क्योंकि सावधानीपूर्वक जांच के दौरान विसंगतियां सामने आ सकती हैं। इन जोड़तोड़ों की जटिलताओं को समझने के लिए एक चतुर आंख और कान की आवश्यकता होती है।

टेक्स्ट-आधारित डीपफेक लिखित डोमेन में उद्यम करते हैं, ऐसी सामग्री तैयार करते हैं जो किसी विशेष व्यक्ति की लेखन शैली की नकल करती है। इस तरह के हेरफेर की पहचान में भाषा, स्वर, या असामान्य वाक्यांशों के उपयोग में विसंगतियों के लिए पाठ की बारीकी से जांच शामिल है जो व्यक्ति की विशिष्ट लेखन शैली से विचलित होती है। इन सूक्ष्म परिवर्तनों को उजागर करने के लिए भाषाई बारीकियों पर गहरी नजर रखने की आवश्यकता है।

सिंथेटिक मीडिया डीपफेक डिजिटल हेरफेर के शिखर का प्रतिनिधित्व करते हैं, जो पूरी तरह से सिंथेटिक सामग्री बनाते हैं जो छवियों, वीडियो और ऑडियो तक फैली हुई है। पहचान में उन विसंगतियों के लिए सामग्री की जांच करना शामिल है जो बहुत सही लगती हैं या वास्तविक मीडिया में निहित यथार्थवादी खामियों का अभाव है। इन त्रुटिहीन निर्माणों की पहचान करने के लिए प्रामाणिक सामग्री में निहित खामियों की सूक्ष्म समझ की आवश्यकता होती है।

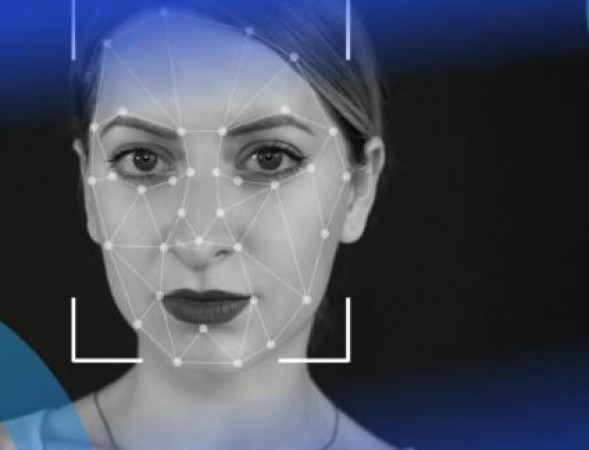

चेहरे की विसंगतियाँ डीपफेक को उजागर करने, अप्राकृतिक त्वचा टोन, बेमेल चेहरे की विशेषताओं और चेहरे के चारों ओर धुंधले किनारों को शामिल करने में प्रमुख संकेतक के रूप में काम करती हैं। ये अनियमितताएं अक्सर सूक्ष्म होती हैं लेकिन सावधानीपूर्वक अवलोकन के माध्यम से इन्हें पहचाना जा सकता है, जिससे हेरफेर की गई सामग्री की पहचान हो सकती है।

असंगत प्रकाश डिजिटल हेरफेर के एक स्पष्ट संकेत के रूप में उभरता है, जिसमें छाया और हाइलाइट्स डीपफेक सामग्री में स्वाभाविक रूप से संरेखित होने में विफल होते हैं। प्रकाश व्यवस्था में इन विसंगतियों का अवलोकन हेरफेर किए गए मीडिया की कृत्रिम प्रकृति में महत्वपूर्ण अंतर्दृष्टि प्रदान करता है।

अवास्तविक आंदोलन डीपफेक वीडियो में निहित डिजिटल कठपुतली को उजागर करते हैं, जिसमें चेहरे के भाव या हावभाव वीडियो के संदर्भ से मेल नहीं खाते हैं। इन विसंगतियों को पहचानने के लिए विस्तार पर गहरी नजर रखने और प्राकृतिक मानव व्यवहार की समझ की आवश्यकता होती है।

आवाज-आधारित डीपफेक की पहचान करने में ऑडियो अनियमितताएं लाल झंडे के रूप में सामने आती हैं, जो अप्राकृतिक ठहराव, रोबोटिक आवाज या स्वर में अचानक बदलाव के रूप में प्रकट होती हैं। ऑडियो सामग्री सुनते समय इन बारीकियों पर ध्यान देने से वास्तविक आवाज़ों को हेरफेर की गई आवाज़ों से अलग करने में सहायता मिलती है।

सामग्री विसंगतियाँ एक अंतर-विषयक संकेतक के रूप में कार्य करती हैं, जो संभावित हेरफेर का संकेत देने वाले ऑडियो और दृश्य तत्वों के बीच गलत संरेखण को प्रकट करती हैं। डीपफेक की जटिलताओं को उजागर करने के लिए इन दोनों आयामों के बीच सामंजस्य की जांच करना आवश्यक है।

जैसे-जैसे तकनीक विकसित होती है, वैसे-वैसे डीपफेक बनाने के उपकरण भी विकसित होते हैं। इन भ्रामक डिजिटल कृतियों के प्रभाव को रोकने के लिए सूचित रहना और सक्रिय उपाय अपनाना महत्वपूर्ण है।

एआई-आधारित जांच उपकरण डीपफेक के प्रसार के खिलाफ अग्रिम पंक्ति की रक्षा का प्रतिनिधित्व करते हैं। उन्नत एल्गोरिदम का लाभ उठाते हुए, इन उपकरणों को डीपफेक सामग्री के संकेतक पैटर्न की पहचान करने के लिए डिज़ाइन किया गया है, जो भ्रामक मीडिया के प्रसार के खिलाफ एक तकनीकी बाधा प्रदान करता है।

डीपफेक के खतरे से निपटने में जन जागरूकता महत्वपूर्ण भूमिका निभाती है। डीपफेक के अस्तित्व के बारे में व्यक्तियों को शिक्षित करना और डिजिटल सामग्री के लिए महत्वपूर्ण मूल्यांकन की संस्कृति को बढ़ावा देना जनता को प्रामाणिक और हेरफेर किए गए मीडिया के बीच अंतर करने का अधिकार देता है।

प्रमाणीकरण उपायों को लागू करने में मल्टीमीडिया सामग्री में डिजिटल हस्ताक्षर और वॉटरमार्किंग को शामिल करना शामिल है। ये उपाय आभासी उंगलियों के निशान के रूप में कार्य करते हैं, प्रामाणिकता के सत्यापन की अनुमति देते हैं और धोखाधड़ी वाले मीडिया के निर्माण और प्रसार के खिलाफ निवारक के रूप में कार्य करते हैं।

डीपफेक तकनीक के नैतिक उपयोग को सुनिश्चित करने के लिए नियामक ढांचे की स्थापना आवश्यक है। नियमों की वकालत करना और उनके विकास में योगदान देना न केवल दुर्भावनापूर्ण अनुप्रयोगों पर अंकुश लगाता है बल्कि इन उन्नत तकनीकी उपकरणों के जिम्मेदार उपयोग के लिए नैतिक मानक भी निर्धारित करता है। ऐसी दुनिया में जहां एक चाबी के झटके से वास्तविकता में हेरफेर किया जा सकता है, डिजिटल इंटरैक्शन में विश्वास और प्रामाणिकता बनाए रखने के लिए डीपफेक को समझना और पहचानना महत्वपूर्ण है। तकनीकी समाधानों, जन जागरूकता, प्रमाणीकरण उपायों और नियामक ढांचे को शामिल करते हुए एक बहुआयामी दृष्टिकोण के माध्यम से, हम सामूहिक रूप से डीपफेक की भ्रामक प्रकृति को उजागर करने का प्रयास कर सकते हैं।